Tóm tắt hơn 20 thuật ngữ kho dữ liệu cho dân data

Thuật ngữ kho dữ liệu xuất hiện và trở nên phổ biến khi xu hướng 4.0 phát triển với tốc độ chóng mặt. Bước vào vũ trụ dữ liệu, hàng ngày phải tiếp xúc với hàng ngàn thuật ngữ kho dữ liệu rất dễ rơi vào tình trạng rối loạn thông tin.

Để ứng biến với sự chuyển đổi của thời đại, bài viết sẽ cung cấp những thuật ngữ thường dùng không thể thiếu đối với dân data.

12 thuật ngữ kho dữ liệu đơn giản phổ biến thường gặp

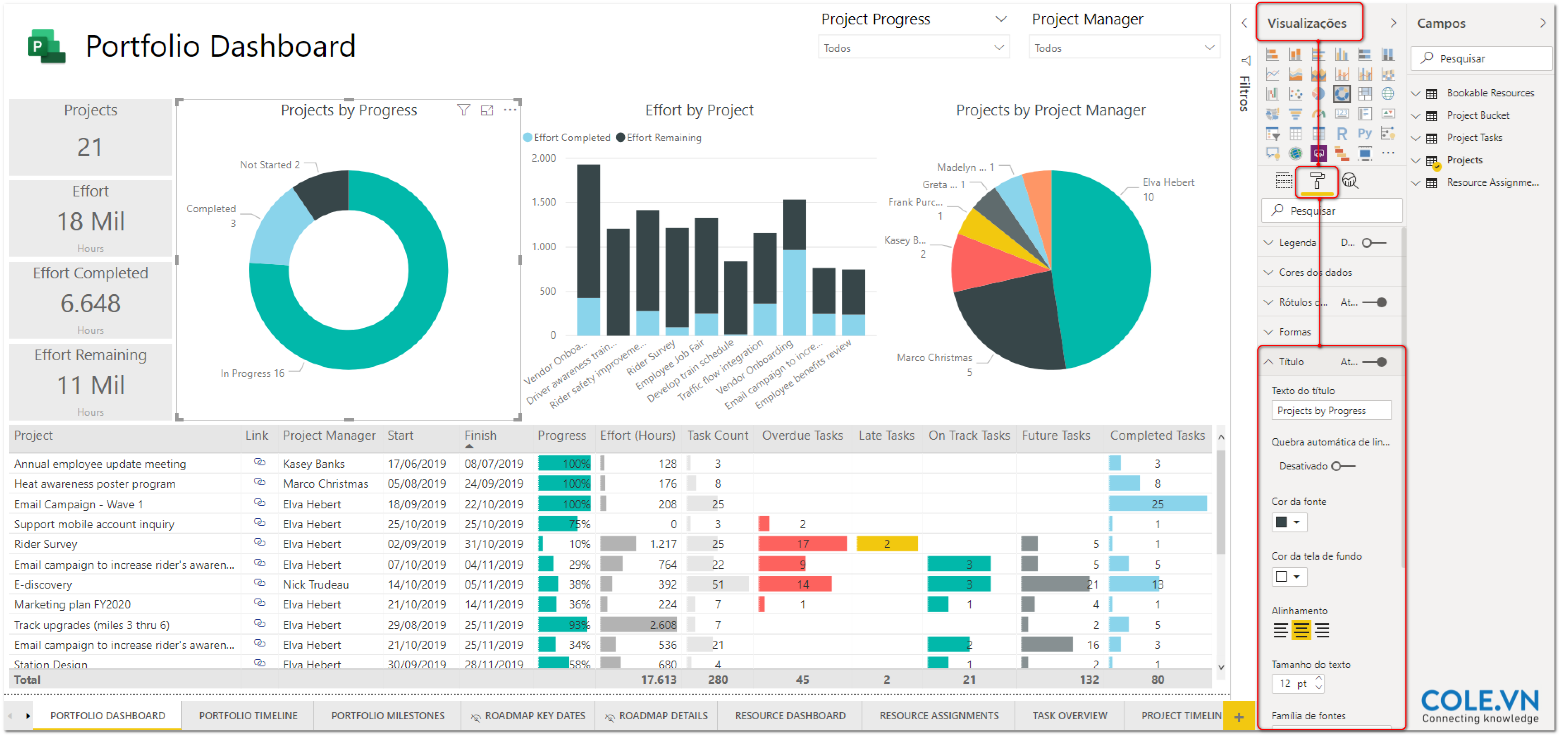

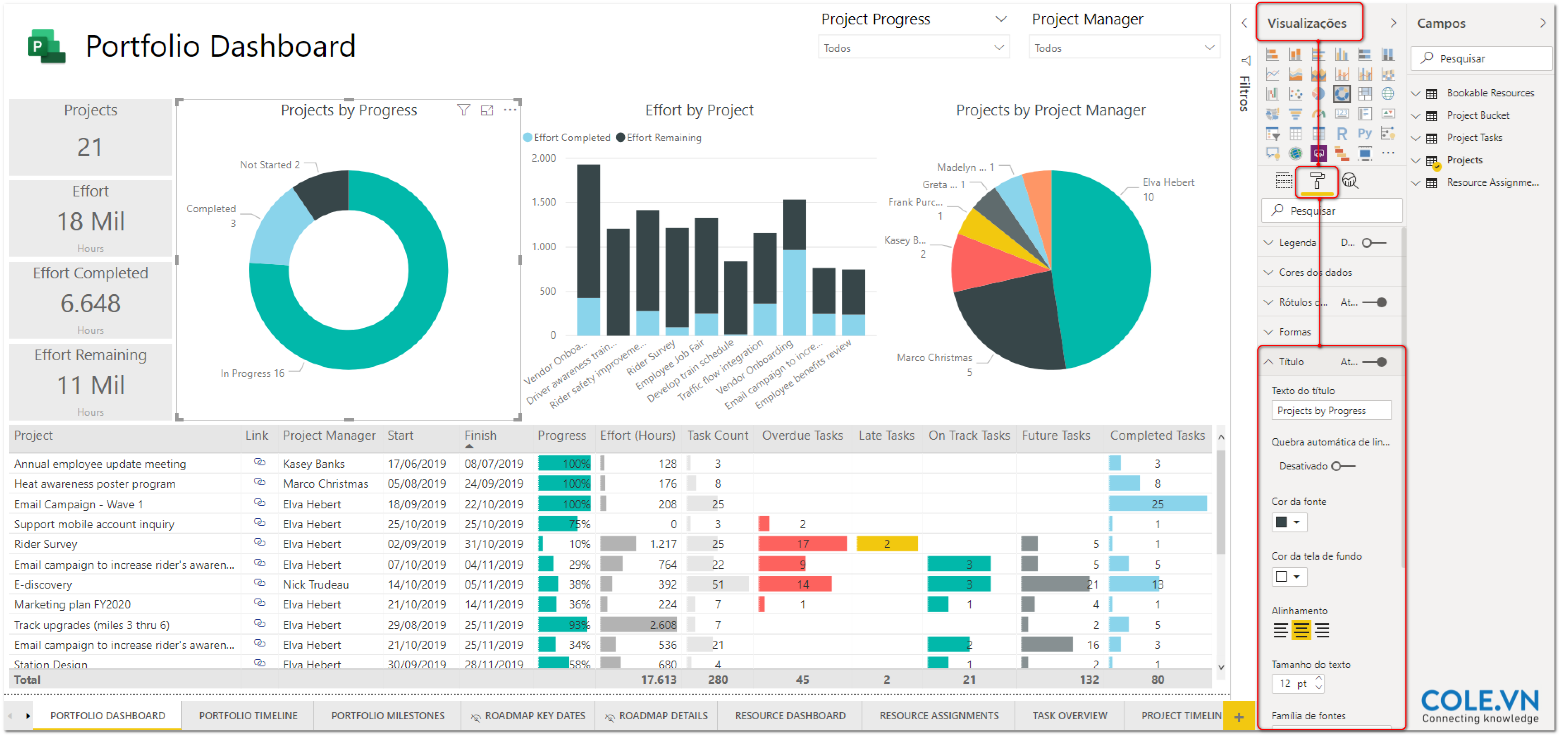

- Business Intelligence (BI): BI là thuật ngữ kho dữ liệu thường được biết đến qua Power BI của nhà Microsoft. BI là quá trình sử dụng dữ liệu từ quá khứ để phân tích và báo cáo tạo tiền đề tối thiểu rủi ro cho các quyết định trong tương lai. BI là công cụ để bạn hoạch định chiến lược tốt hơn bằng những dữ liệu từ quá khứ được trực quan hóa cụ thể các chỉ số như doanh thu, chi phí, lợi nhuận.

- Data Warehouse (nhà kho dữ liệu) là nơi chứa các dữ liệu vô tổ chức được gom lại bởi các công cụ trích xuất dữ liệu, nhà kho dữ liệu biến việc quản lý dữ liệu trở nên dễ dàng hơn.

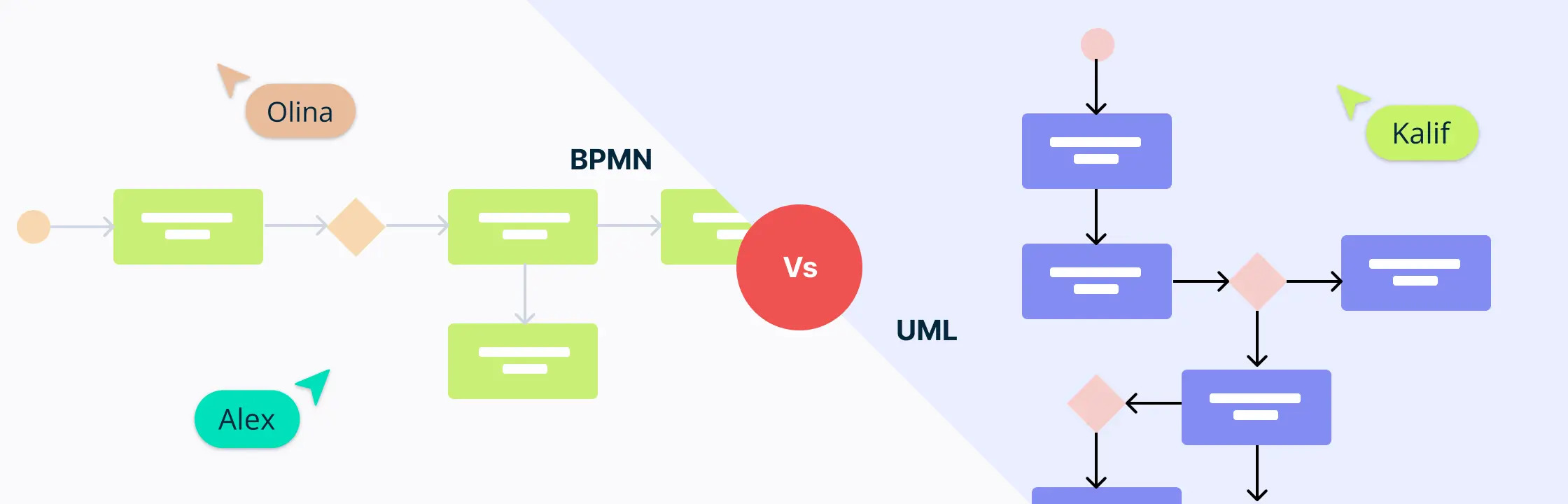

- Data Models (mô hình hóa dữ liệu) dữ liệu được xây theo 1 mô hình biểu hiện mối quan hệ liên hợp logic và luồng dữ liệu giữa các phần tử dữ liệu khác nhau vào trong cùng một môi trường thông tin. Mô hình dữ liệu sẽ ghi lại cách hàng hóa được lưu trữ và truy xuất. ERD cũng được xem là một trong những mô hình khá phổ biến hiện nay.

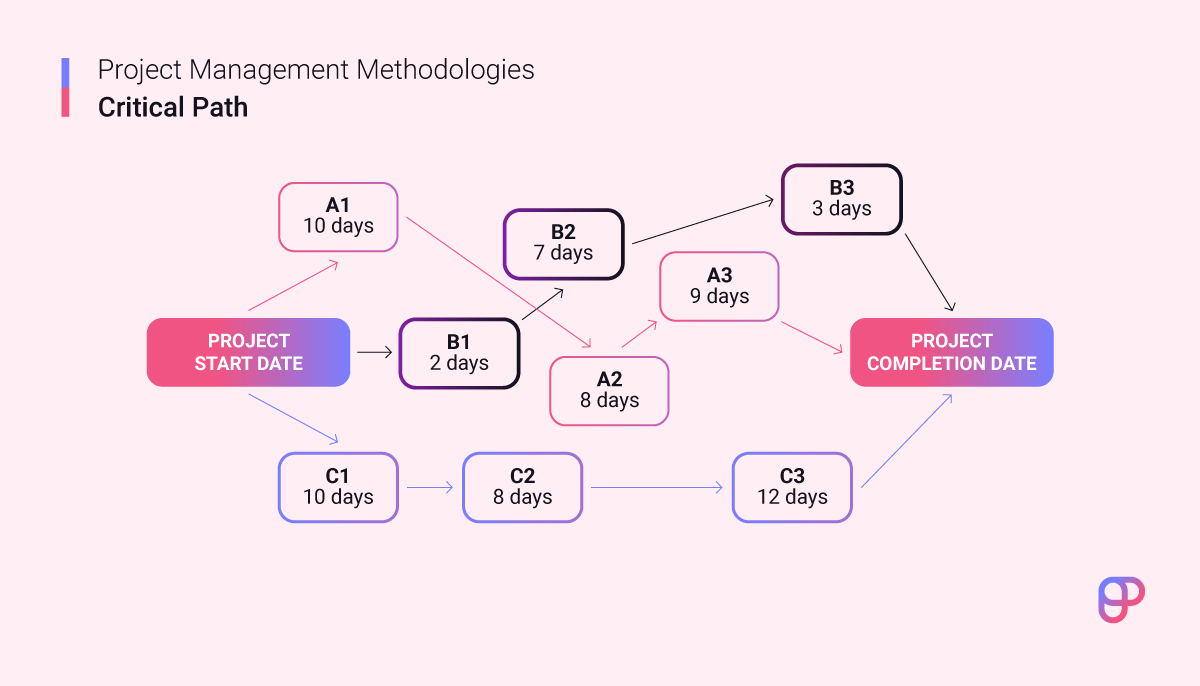

- ETL trong thuật ngữ kho dữ liệu là tên viết tắt của Extract, Transform, Load – là một loại tích hợp dữ liệu gồm một chuỗi quy trình gồm 3 bước (trích xuất, truyền đổi, tải) được sử dụng để chuẩn bị dữ liệu phục vụ cho hoạt động kinh doanh và ra quyết định của công ty. Trong một chuỗi quy trình từ nguồn tới đích, ETL đầu tiên sẽ trích xuất lấy dữ liệu từ những nguồn khác nhau, chuyển đổi dữ liệu bằng cách áp dụng các phép tính, ghép nối,… và cuối cùng là tải dữ liệu vào kho dữ liệu (data warehouse).

- Data Engineer (Kỹ sư dữ liệu) khác với kỹ sư cầu đường, kỹ sư xây dựng, kỹ sư dữ liệu là thuật ngữ để chỉ những người xây dựng cơ sở hạ tầng như nhà kho dữ liệu, làm sạch dữ liệu, lưu trữ dữ liệu. Kỹ sư dữ liệu sẽ chế biến dữ liệu đưa cho các nhà khoa học dữ liệu để họ sử dụng.

- Data Analyst (Chuyên viên phân tích dữ liệu) từ dữ liệu mà Data Engineer đã xử lý, Data Analyst sẽ sử dụng dữ liệu phục vụ cho các mục đích như báo cáo, nhận định các chỉ số, dự báo xu hướng, ảnh hưởng của các yếu tố tương quan với nhau.

- Data scientist (Nhà khoa học dữ liệu) là người cung cấp các thuật toán, mô hình thống kê cho Data Analyst đưa vào sử dụng. Một nhà khoa học dữ liệu sẽ có những kỹ năng cơ bản sau: các phép đo thống kê, phân tích, lập trình.

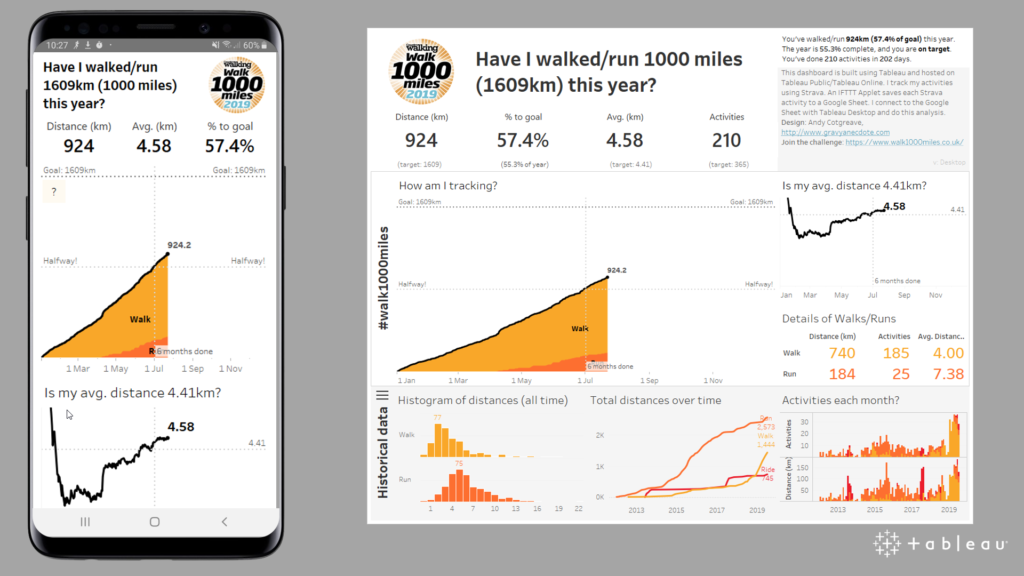

- Trực quan hóa dữ liệu (Data Visualization) là thuật ngữ kho dữ liệu mô tả việc chuyển đổi từ những excel số liệu, báo cáo bằng số, tài liệu chữ thành bảng, biểu để người xem có được cái nhìn tổng quát về tình hình, nắm được báo cáo dễ dàng, hiểu được ý nghĩa của dữ liệu. Dữ liệu được đưa vào sau khi trực quan hóa sẽ là thông tin qua những dashboard.

- Khoa học về việc đưa ra quyết định (Decision Science) nhằm mục đích hiểu người dùng tốt hơn, các phương pháp máy học, toán học được áp dụng để đưa ra quyết định mà không cần tới bước xét duyệt bởi con người trong khuôn khổ nhất định. Lấy ví dụ như Facebook, Tiktok, Youtube đã ứng dụng Decision Science vào trong trải nghiệm người dùng của khách hàng, dựa trên dữ liệu của khách hàng và quá trình máy học sẽ đưa ra quyết định hiển thị những gì trên từng tài khoản cá nhân của khách hàng (một quá trình nhắm tới việc hiểu người dùng cuối tốt hơn).

- R là ngôn ngữ lập trình được sử dụng nhiều nhất cho điện toán thống kê. R được các nhà thống kê và nhà khai phá dược liệu (data miner) sử dụng làm ngôn ngữ lập trình cho các phần mềm thống kê và phân tích dữ liệu.

- Python là ngôn ngữ lập trình bậc cao, khả năng đa dụng, được ứng dụng nhiều nhất trong lập trình web, machine learning, deep learning, AI. Các ông lớn như Facebook, Youtube cũng đang sử dụng Python làm ngôn ngữ lập trình.

- SQL – Structured Query Language (ngôn ngữ truy vấn có cấu trúc) là ngôn ngữ chuyên biệt có thể thực hiện các tác vụ (chọn, thêm, xóa, chèn, cập nhật…) trên cơ sở dữ liệu hoặc nhà kho dữ liệu.

>> Xem thêm quy trình 11 bước triển khai kho dữ liệu chi tiết:

15 thuật ngữ chuyên sâu về kho dữ liệu

- Máy học (Machine Learning) là một nhánh nhỏ của trí tuệ nhân tạo (Artificial Intelligence – AI). Khi nhập vào máy học dữ liệu đầu vào, máy sẽ bắt đầu quy trình học và nhận ra các quy luật trong dữ liệu đó, trên cơ sở quy luật từ dữ liệu đầu vào, máy học áp dụng quy luật đã hình thành vào những dữ liệu mới hoặc yêu cầu mới.

- Supervised Learning (Học có giám sát) là loại máy học có sự giám sát của các Data Scientist (nhà khoa học dữ liệu) hướng dẫn và điều chỉnh để thuật toán tạo ra kết quả như mong muốn thay vì cho thuật toán tự học. Ví dụ, máy tính học các phân loại phương tiện di chuyển trên đường bằng việc được huấn luyện dựa trên một tập các hình ảnh được gắn nhãn chính xác mỗi loại xe và đặc điểm riêng biệt của từng loại.

- Classification (Phân lớp) là học có giám sát giúp giải quyết bài toán phân phối dữ liệu vào danh mục phù hợp dựa theo tập hợp đặc tính của danh mục đó mà máy đã được huấn luyện. Ví dụ, Classification phân nhóm khách hàng cao dưới 1m3, 1m3-1m6, 1m6-1m8, 1m8+ dựa trên việc máy học được huấn luyện bằng các dữ liệu hình ảnh chiều cao của con người theo từng phân nhóm.

- Cross validation (Xác thực chéo) dùng để kiểm tra tính ổn định và độ chính xác của mô hình máy học. Phương pháp cơ bản nhất là chia dữ liệu dùng để huấn liệu máy thành 2 phần và ghi lại kết quả luyện tập của từng phần, đối chiếu 2 kết quả huấn luyện để kiểm định được mô hình học máy.

- Clustering (Phân cụm) là thuật ngữ kho dữ liệu thuộc loại máy học không có giám sát. Thuật toán sử dụng dữ liệu đầu vào và tìm những điểm tương đồng trong bản thân dữ liệu đó sau đó nhóm các điểm dữ liệu giống nhau lại.

- Deep Learning (Học sâu) là bậc cao hơn của máy học, học sâu ám chỉ tới những hệ thống có nhiều lớp đầu vào/đầu ra. Để ứng dụng giải quyết các vấn đề phức tạp ở thế giới thực, học sâu cần có vài chu kỳ dữ liệu đầu vào/đầu ra.

- Linear Regression (Hồi quy tuyến tính) là mô hình thể hiện tương quan giữa 2 biến thể thông qua áp dụng một phương trình tuyến tính vào dữ liệu quan sát được. Bằng cách này sẽ dự đoán được ảnh hưởng của biến còn lại dựa trên biến liên quan đã biết. Một ví dụ đơn giản là mối quan hệ giữa chi phí và lợi nhuận.

- A/B Testing là một thử nghiệm trên 2 biến thể để tìm ra biến thể nào là tốt nhất.

- Hypothesis Testing (Kiểm định giả thuyết) được sử dụng trong nghiên cứu lâm sàng, sử dụng thống kê để giảm định xác suất để một giả thuyết được đưa ra là đúng.

- Statistical Power (Sức mạnh thống kê – SP) là xác suất khả năng một nghiên cứu sẽ phát hiện ra một tác động khi có một tác động để phát hiện. Dựa vào chỉ số SP, có thể kết luận được một biến có tác động hay không.

- Standard Error (Sai số chuẩn) là con số đo lường độ chính xác về mặt thống kê của một mẫu. Mẫu thống kê có dung sai càng lớn, sai số chuẩn càng nhỏ.

- Causal Inference (Suy luận nhân quả) là quá trình kiểm tra xem trong 1 tình huống cho trước có mối liên hệ hệ giữa nguyên nhân và tác động hay không (cause and effect).

- Exploratory Data Analysis (Khám phá dữ liệu – EDA) là bước đầu tiên khi phân tích dữ liệu. EDA được các nhà khoa học dữ liệu dùng để tóm tắt các đặc tính chủ yếu của một tập dữ liệu và thông báo sự phát triển của các mô hình phức tạp hơn hoặc các bước logic tiếp theo.

- GitHub là cộng đồng dành cho các lập trình viên, trong đó có dịch vụ xuất bản và chia sẻ code. Github cho phép truy cập và tạo tính năng làm việc nhóm, ví dụ như theo dõi bug, yêu cầu tính năng, quản lý tác vụ và cấp thông tin chung cho mọi dự án. GitHub cung cấp cả repo riêng tư và các repo miễn phí – thường được sử dụng để lưu trữ mã nguồn của các dự án nguồn mở.

- Artificial Intelligence (Trí tuệ nhân tạo – AI) là hệ thống máy học, học sâu được thiết kế để thực hiện các tác vụ đòi hỏi trí tuệ của con người. AI bắt chước cấu trúc của não người, sử dụng những nguyên tắc suy luận của con người như một mô hình để cung cấp các dịch vụ hoặc tạo ra các sản phẩm tốt hơn, như nhận diện giọng nói, ra quyết định và dịch ngôn ngữ.

Như vậy với 27 thuật ngữ kho dữ liệu gồm cả cơ bản và chuyên sâu Cole hy vọng đã chia sẻ được tới bạn kiến thức cũng như giải đáp được những thắc mắc bạn đang gặp phải.

>> Khóa học data analyst từ A-Z – Lớp học data analysis từ Intern – Specialist: https://cole.edu.vn/khoa-hoc-data-analyst-data-analysis/

>> Khóa học data engineer Cole – Hướng dẫn thực hành SISS ETL Bigdata Data Lake và Data warehouse: https://cole.edu.vn/khoa-hoc-data-engineer/